文/蔡孟凌

AI 造成的黑箱問題,正在成為企業治理的新戰場。這不僅僅是一個技術挑戰。當演算法不再只是輔助工具,而是實質參與決策、甚至成為獨立的「行為者」時,「可否被驗證」(Verifiability)已經成為比「是否有效」更關鍵的問題。

近年來,多起涉及 AI 的法律爭議——從美國 Workday 招聘演算法被控存在年齡歧視、Anthropic 訓練數據侵權的和解案,到律師因誤用 AI 提供的虛假案例而遭法院罰款——都在顯示同一個現象:AI 不只是技術問題,它正在從根本上重塑企業的信任邏輯與責任邊界。

[ 加入 CIO Taiwan 官方 LINE 、 Facebook 與 LinkedIn,與全球CIO同步獲取精華見解 ]

對企業而言,這意味著我們必須用全新的框架來審視風險。如果連我們自己都無法解釋 AI 為何做出某項決策,又該如何向董事會、監管機構,甚至法庭證明我們決策的正當性?

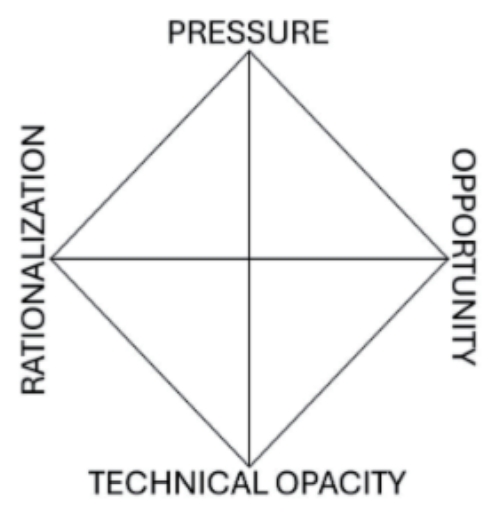

當詐欺三角遇上 AI:從「動機」到「結構」的風險轉移

在傳統舞弊研究中,詐欺的發生取決於「壓力、機會、合理化」三要素,主要解釋了人類行為動機。然而,當 AI 深度參與決策時,這套理論遭遇斷層—AI 既無壓力也無合理化需求,卻能憑藉其固有的不透明性,創造前所未有的巨大「機會」,從根本上放大組織的脆弱性。這正是英國杜倫大學學者 Jonathan McConnell 與澳洲新南威爾斯大學教授 Edward N. R. Dorsey 在近期提出的「AI-Fraud Diamond 理論」,該理論以傳統詐欺三角為基礎,新增了第四個關鍵構面——技術不透明性(圖)。

這個理論精準地指出:AI 的不透明不只是技術缺陷,它本身就是一種生成風險的結構性條件。在企業導入 AI 的實務環境中,這種黑箱結構可以透過多種形式顯現:模型的訓練資料來源無法追溯、連開發團隊都無法解釋演算法的內部權重與決策邏輯、系統決策缺乏完整且可供審計的日誌等。

當黑箱成為常態,企業就等於將自己置於一種「可被利用的信任結構」中。任何無心的技術偏差、或是刻意的惡意操作,都可能被完美地掩蓋在模型的複雜性之下,等待時機爆發。

試想一個場景:一家金融單位為了加速放款流程、降低人力成本,導入了一套 AI 信用評分模型。這套模型由外部廠商提供,宣稱準確率高達 99%。管理層認為,既然系統如此高效,過去繁瑣的人工審核程序就可以大幅簡化。此時,「技術是中立的」、「數據會說話」便成了最完美的合理化藉口。

[ 推薦文章:虛擬資產普及化下的資安新課題:用戶級風險管理崛起 ]

當這套 AI 系統能以更低成本、更快速度產生「看似高準確率」的結果時,任何質疑其內部邏輯或要求審查的聲音,都很容易被視為「阻礙創新」或「沒有效率」。模型若存在系統性偏誤(例如,對特定族群、職業的申請者給予不合理的低分),也很容易被管理層描述為「可接受的統計誤差」。

然而,這一切其實都在掩飾組織對於新型態風險的集體麻痺。

更嚴重的是,AI 的不透明特質讓這些問題極難被即時發現。企業內部的稽核或法遵團隊,往往只能看到 AI 輸出的「結果」(例如,本月拒絕了 500 個申請),而無法真正進入模型的決策「過程」進行驗證。

這種權力與資訊的極度不對稱,正是 AI 時代企業風險的真正本質。

從「結果審查」到「過程驗證」:AI 治理的結構性轉型

要破解 AI 的黑箱詛咒,企業治理必須完成一項根本性的轉型:從「結果審查」轉向「過程驗證」。目前,絕大多數企業在評估 AI 時,仍停留在「結果審查」的淺層。我們緊盯著輸出準確率、錯誤率或模型性能(如 F1-Score)等指標。這種做法,充其量只能看到 AI 行為的表面,卻永遠無法揭露模型內部潛藏的偏誤、歧視,以及潛在的惡意操作風險。

真正的 AI 審計,可以參考我在本專欄中曾多次提及的「區塊鏈思維」。我在 2025 年 4 月的專欄中曾提到:「區塊鏈透過去中心化的機制建立了更安全可信的資料記錄環境,而 AI 則能有效利用大量資料實現自動化流程與智慧決策。」這種協同效應,正是 AI 治理的解方。

我們需要的是一套「診斷式」的稽核方法,從模型生命週期的每一個階段,植入「可驗證性」的基因:

- 訓練階段:導入「數據溯源」

這等同於為每一筆訓練資料建立「數位身分證」。我們必須確保資料的來源可追溯、不可篡改,並嚴格防止數據污染。這就像區塊鏈上的交易紀錄,任何 Garbage-In 的源頭都必須能被立刻揪出。 - 部署與更新階段:建立「模型版本控制」與「變更日誌」

AI 模型絕非一成不變。每一次的參數調校、演算法更新,都必須像智慧合約的升級一樣,留下清晰、可供審計的變更紀錄。這能確保任何對模型的修改都有跡可循,防止未經授權的黑箱作業。 - 運行階段:強制「可審計的操作日誌」

這是最關鍵的一步。AI 的每一次推論、每一次決策,都必須被視為一筆「交易」,被完整記錄在案。日誌必須詳盡到足以讓第三方(如稽核單位或監管機構)能夠重現當初的決策過程。這等同於將 AI 的思考路徑上鏈,使其透明且可供查核。 - 審查階段:落實「獨立的偏誤與公平性驗證」

企業應建立跨部門的 AI 審計制度,針對模型的偏誤與公平性進行獨立驗證,絕不能讓開發團隊球員兼裁判地自我審核。技術團隊與法遵、風控單位之間,必須保持必要的張力與制衡。

這些措施並非空談,它們是金融監理實務的必然延伸。如同全球銀行業多年來實施的「模型風險管理制度(MRM)」,嚴格要求所有風控模型須有完整的審計軌跡,並接受持續的內外部查核。對 AI 而言,透明與可驗證性不該是錦上添花的功能,而是獲取信任的基礎設計。

[ 閱讀 蔡孟凌 所有專欄文章 ]

在人工智慧時代,企業最大的風險不再只是「誰在做錯事」,而是「誰能解釋發生了什麼」。真正的詐欺,未必來自刻意的惡意行為,而可能源於一套我們無法驗證、卻盲目信任的系統。

在下一個階段,AI 治理的關鍵,不再是如何讓機器變得更聰明,而是如何讓我們的決策,變得更誠實、更可被檢驗。

(本文授權非營利轉載,請註明出處:CIO Taiwan)