文/洪為璽

在 2026 年初,AI 領域爆發了一場象徵性的衝突,焦點是企業對 AI 倫理的界限與政府對 AI 戰略需求之間的矛盾。這場衝突的主角是「Anthropic」,一家以 AI 開發為核心宗旨的公司,其旗艦產品是 Claude 系列的大型語言模型。

當美國國防部要求 Anthropic 取消對軍事用途的限制時,Anthropic 拒絕讓 AI 成為武器或監控工具,引發美國政府將其列為供應鏈風險的對峙,因此在業界和全球政策圈掀起廣大的討論。這場衝突不僅影射企業與政府之間權力的重新分配,也浮現出 AI 產業在價值取向、商業信任與主權 AI 之間的交錯複雜關係。

從工具走向價值與權力的分界點

AI 從一種技術工具演變為國家安全及社會秩序的戰略資源,這點在 Anthropic 與美國政府的對抗中表露無遺。AI 公司通常被視為技術供應商,研究模型效能、商用應用與市場拓展。然而,當涉及到武器系統、國防部署與監控等用途時,技術不再只是純粹的工具,而成為決策者權力的延伸。

The Washington Post(2026)報導指出,美國國防部要求 Anthropic 允許 AI 技術被用於所有合法用途,包含自主武器和大規模監控,其顯示美國政府在緊急國安考量下對私部門技術的需求。

[ 加入 CIO Taiwan 官方 LINE 、 Facebook 與 LinkedIn,與全球CIO同步獲取精華見解 ]

然而,站在 Anthropic 的立場,即使法律框架允許,AI 技術也不該在缺乏人類控制與倫理保障的情況下用於攸關生死的任務。為此,兩方立場挑戰政府對 AI 的控制權,也重新釐清“工具”與“價值判斷工具”之間的邊界。

此衝突背後也描繪出一個趨勢,AI 模型不再只是提升生產效率的工具,而是可用來做決策、監控及控制整個社會系統的權力中心。若 AI 失去倫理的約束,技術上不僅能協助製造武器,也能重塑國內外的政策環境,這對多數企業來說,過去的 AI 技術採購必須更新為 AI 價值判斷與風險治理的框架。

倫理立場如何轉化為商業信任?

Anthropic 所提出的拒絕立場,不僅是技術性的拒絕,更是倫理上的宣言。Anthropic(2025)於使用政策(Usage Policy Update)中提到其 AI 模型不得用於大規模監控或侵犯基本人權的用途,這種堅持反而易於在企業客戶中建立深層的信任。例如,企業客戶在安全、醫療、金融風險管理等相關領域逐漸重視對 AI 決策的可預見性與倫理可控性,這也是 Anthropic 所強調的訓練原則與使用政策。

在商用市場上,此價值保障有別於其他大型 AI 供應商,更具競爭力,尤其是大多 AI 供應商在軍事應用上採取讓步時,Anthropic 的堅持讓部分企業客戶青睞,因企業在選擇供應商時,不只是考量技術的能力,也會評估供應商是否符合自身的聲譽風險與法規遵循。在高度監管的行業中,例如金融與醫療,企業不僅要看短期效益,而更應是保障及確認 AI 系統符合倫理規範與社會責任。

從倫理到商業信任的轉化,顯示 AI 供應商正透過價值主張建立市場差異化。這也暗示一個重要趨勢,企業在選擇 AI 技術合作夥伴時,需加入道德與社會責任的維度來估評,不再僅以性能、成本與速度為衡量的標準。

當 AI 公司開始制衡政府

Anthropic 與美國政府之間的衝突,屬於企業對政府技術需求發出反擊的案例。在過去,科技公司在軍事或政府合作中常扮演配角,但 Anthropic 拒絕服從政府使用的要求,並採取法律途徑挑戰政府的做法,讓單純的供應關係演變成權力的對決(Tech Policy Press, 2026)。政府方面甚至將 Anthropic 的舉動視為供應鏈風險,禁止該公司參與某些國防合作,指稱可能會影響緊急情況下的靈活性(Reuters, 2026)。

由此可見,政府對關鍵技術的掌控被視為國安不可或缺的部分。然而,AI 世界不同於軍工產業的供應體系,AI 技術具有高度泛用性與迅速擴散的特性,使它既服務於公共部門,也能在消費與企業市場中發揮價值,這種雙重用途性導致政府必須重新思考技術採購與監管的應用策略,而企業也開始探索如何作為價值制定者的角色。

Anthropic 的反制反映出一種新的權力結構,當技術能力日益重要時,企業不再只是政府的工具,而是可根據價值立場與商業生態選擇合作或不合作。這對企業來說意味著在衡量政府需求時,不僅要考量法律與合規風險,還須評估技術合作是否可能對自身品牌、員工價值觀與客戶信任造成日後的影響。

主權 AI × 商業 AI × 價值 AI

Anthropic 的案例也指出 AI 產業目前所面臨的三種邏輯:主權AI、商業 AI 與價值 AI。

● 主權 AI:是指各國政府盼望透過掌握核心 AI 技術來維護國家安全與戰略優勢,例如印度泰米爾納德邦政府與 Sarvam AI 簽署了備忘錄,將建立印度第一個主權人工智能園區(The Economics Times, 2026)。在地緣政治競爭中,技術等同於武力與影響力,因此政府期望在 AI 研發與部署上擁有主導權。Anthropic 在拒絕開放主權 AI 給軍方的同時,也顯示出政府強調主權利益的壓力。

● 商業 AI:是由市場機制所主導,關注企業價值創造、客戶需求與競爭優勢。在此邏輯下,AI 技術的採用與應用場域多以產業需求、效能提升與成本效益作為主要考量。Anthropic 在企業客戶端的受歡迎程度就是這種邏輯的體現。

● 價值 AI:強調倫理、社會影響與人類核心價值的保障。這種邏輯出現在學術界與公益團體中,在具前瞻視野的企業策略裡也佔一席之地。Anthropic 透過制定使用政策、拒絕政府的需求,實際上是在推動價值 AI 的實踐。

主權 AI、商業 AI 與價值 AI這三種邏輯並非互相排斥,而是交織在 AI 產業的競爭與治理格局裡。當前企業在制定 AI 相關策略時,不僅要考量技術與商業需求,還需理解國際政策與倫理趨勢互相的影響。例如一項看似技術型的合作案,或許因地緣政治政策或倫理風險被迫調整方向。

企業如何建立 AI 判斷能力?

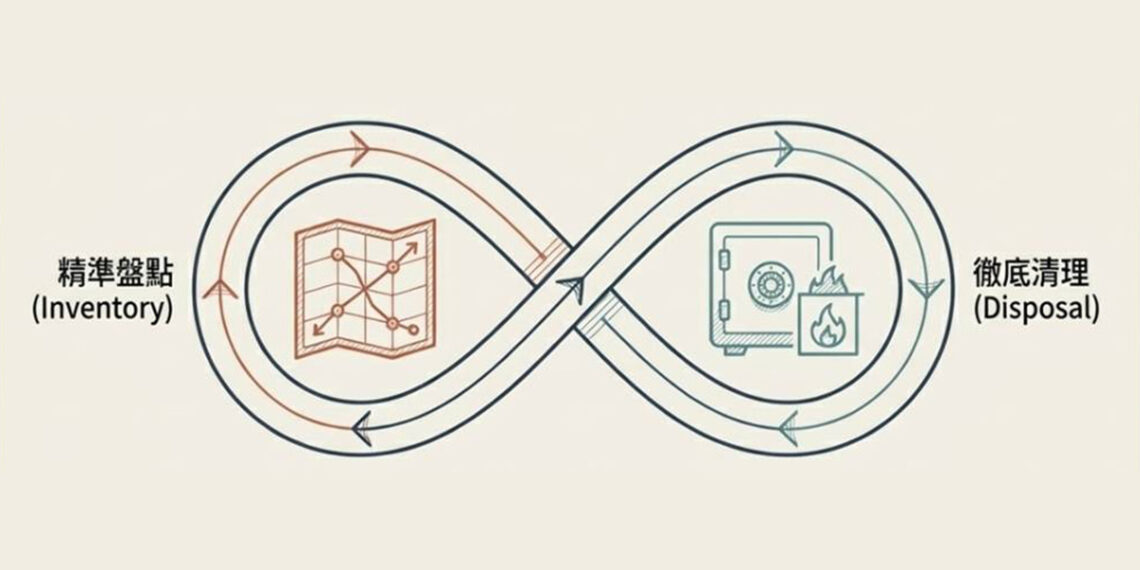

面對目前多層次的 AI 生態,企業需建立 AI 判斷能力,以下分成方向來探討:

- 建立倫理與社會價值敏感度

AI 的使用不僅是單一技術策略,而是涉及倫理、法律與社會價值。企業必須識別哪些用途可能引發法律風險或傷害品牌的形象,並制定相關的治理框架。例如禁止在某些情況下使用 AI 自主決策,或建立人類監督機制以降低風險。

- 評估合作夥伴的價值觀

像 Anthropic 這樣的公司將價值觀融入產品政策中,可能會在一些政府合同中失去機會,卻在企業市場獲得信任。企業在選擇技術供應商時,需理解對方的價值取向是否與自身相符。

- 發展 AI 風險管理框架

企業必須建立 AI 風險的評估機制,包含合規要求、倫理風險、操作性風險、以及與政府合作的政策風險。這些風險管理框架有助於面對外部壓力時做出判斷。

- 參與政策制定與跨業協作

AI 不單只是企業所應用的技術,而是全球科技與政策的核心資源。企業可透過產業聯盟、跨業合作組織或標準制定機構,參與制定 AI 使用準則與實踐,讓自身聲音在政策制定中被聽見。

- 彈性策略

在主權 AI 與商業 AI 的張力中,企業需具備彈性策略,根據不同市場與政策情境調整戰略。例如在不牴觸核心價值與法規時,選擇符合安全要求的用途,在其他領域保留創新。

選擇將是重要考驗

從產業結構來看,Anthropic 事件反映出三種 AI 邏輯在同時運作並交錯。

首先是主權 AI 的崛起,各國政府希望掌握自身資料、模型與算力,避免依賴並確保國家資訊安全。其次是商業 AI 的拓展,以效率與創新為核心,推動企業導入生成式 AI。最後是價值導向AI的出現,強調在技術中建立倫理限制,降低潛在的風險。這三種邏輯並非互斥,反而在不同情境下產生張力。

通常企業面對這些選擇時,無法採取單一策略,但必須在不同場景下做出調整。例如,涉及敏感資料或法規要求時,偏向主權 AI;追求效率與創新時,則傾向商業 AI;而在風險應用中,則需依賴具備倫理限制的價值 AI。這也代表企業IT架構逐漸走向混合模式,而非單一主導。

[ 閱讀更多 洪為璽 的專欄文章 ]

現今企業真正需要建立的能力,並不是單純的技術導入,而是持續判斷的治理機制。Anthropic 與美國政府的衝突,實際上是 AI 治理的壓力測試,當技術、價值與利益發生衝突時,企業所面臨的不確定性。未來這種情境會更加頻繁,且可能出現在不同的產業。

因此,企業的角色須面臨轉變。從以往的技術導入決策者,轉變成 AI 治理與風險管理的核心角色。同時,需要建立跨部門的 AI 管理機制,將 AI 納入治理架構之中,包含資安、法規遵循與品牌風險。此外,多供應商策略也須列為考量,降低對單一 AI 平台的依賴。從整體的角度來看,AI 的發展在從「是否導入」的問題,轉變為「如何治理」的問題。企業若沒有提前佈局,即使擁有先進的模型,也可能在面對政策變動或市場壓力時陷入困境。

Anthropic 拒絕成為戰爭工具,並沒有提供明確答案給各界,反而揭示 AI 時代的複雜與矛盾性。AI 不再是技術競賽,而是價值、權力與治理的競爭。企業需要思考的不只是使用 AI,而是如何使用、在什麼規範下使用,以及須承擔哪些風險。

對企業而言,並不在於選擇哪一個模型,而在於如何在主權、商業與價值三種邏輯之間取得平衡。未來企業競爭力的關鍵,將不再是 AI 能力本身,而是對 AI 的判斷能力與治理能力。在沒有標準答案的時代,AI 的終局並不是誰的模型最強,而是誰在不確定的環境中,持續做出負責任的選擇。

(本文授權非營利轉載,請註明出處:CIO Taiwan)