文/徐燁儀

過往新興科技出現,各行各業爭相使用,企業內多僅要求高階主管或相關技術部門須能掌握相關運作原理,鮮少需對消費者或一般民眾加以解釋。然而 AI 技術的應用領域既深且廣,影響範疇已遍及民眾日常生活,有時甚至直接與個人重要權益(例如:銀行核貸與否、企業履歷篩選等)切身相關。此時, AI 演算法的「黑盒子(Black Box)」特性對於解釋 AI 運作原理這項議題成為一項障礙。

為確保民眾權益受適當保障,我國「人工智慧基本法」和金管會公布之「金融業運用人工智慧(AI)之核心原則」均要求業者運用 AI 時,應落實透明與可解釋性。當金融業紛紛擁抱生成式 AI 與預測模型,隨之而來的挑戰即是如何證明自家 AI 符合相關規範要求,並可適度保障消費者「知的權利」,以提升民眾對於 AI 的信任度。

從 NIST 框架看解釋力:不僅是除錯,更是信任基礎

依據美國國家標準暨技術研究院(NIST)發布的人工智慧風險管理框架(AI RMF 1.0)指出,所謂 AI 可解釋性(Explainability)指的是對於 AI 系統運作底層機制的表述,也就是說明 AI 系統是如何做出決策的。

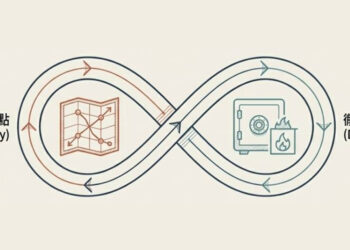

前述管理框架更進一步提及,人們對於 AI 系統產生負面風險的認知,通常源自於無法合理理解系統運作方式,或缺乏適當解讀系統輸出結果的能力;而具備可解釋性的系統則能提供必要資訊,幫助使用者理解 AI 系統的運作目的與潛在影響。此外,具備可解釋性的系統更容易進行除錯和監控,也有利於建立更徹底的文件紀錄、稽核與治理機制。反之,若 AI 系統缺乏可解釋性或系統不夠透明,將導致系統變得難以捉摸,使 AI 的風險衡量變得更加複雜與困難。

三層次拆解決策邏輯:金管會指引的實務落地

金管會所發布的「金融業運用人工智慧(AI)指引」中,針對金融機構應符合的 AI 可解釋性定義,另有基於實務考量加以限縮。因金融機構如果是委託其他第三方業者研發或直接購入既有 AI 系統,可能因涉及業者商業機密,無法完全得知 AI 系統運作細節,因此特別將「可解釋性」界定為:「可清楚說明自行或委託研發並使用之 AI 系統如何運作及其預測或決策過程背後之邏輯,以利組織內評估是否符合內部政策、作業流程及監管要求等。」換言之,重點並非要求金融機構完全拆解 AI 模型的技術細節,而是確保其對模型決策邏輯具備足夠的理解與說明能力。

在實務操作上,金融機構可從資料來源、模型邏輯與結果說明三個層面落實可解釋性。例如,當金融機構使用 AI 模型評估客戶財力與信用評分,進而決定放貸利率或是否核貸時,至少應能清楚說明該模型主要參考的資料類別與影響因子,例如資產總額、收支情形、消費紀錄、職業類別、過往信用紀錄或負債比等,並能合理解釋各類因素對評分結果的可能影響。雖然金融機構無須詳細解釋大型語言模型或深度學習模型的演算法運作方式,但仍須能說明模型決策背後的主要判斷依據與變數影響方向,使內部風險管理單位、稽核單位或監理機關能理解模型決策的合理性。

[ 加入 CIO Taiwan 官方 LINE 、 Facebook 與 LinkedIn,與全球CIO同步獲取精華見解 ]

此外,金融機構亦可透過建立模型文件化與解釋工具機制來強化可解釋性。例如在模型導入前建立完整的模型說明文件,記錄模型用途、主要變數、資料來源、訓練方法與適用限制;在模型運作過程中,則可運用特徵重要度分析或解釋性工具(如 SHAP、LIME)輔助分析各變數對模型預測結果的影響程度,作為內部審查與監理溝通的依據。舉例來說,透過 SHAP 工具,銀行能具體向內部稽核說明,在某次信用評分中,「過往信用紀錄」佔了 40% 的決策權重,而非僅是交給機器盲目運算,藉此作為內部審查與監理溝通的有力依據。透過這類方法,即使金融機構無法取得完整的演算法細節,仍可對模型行為建立一定程度的可理解性與可驗證性。

另應留意的是, AI 的可解釋性與模型的預測準確性之間,往往存在一定程度的權衡關係。在實務應用中,為了使模型決策過程更容易被理解,金融機構可能會選擇採用結構較為簡單且邏輯清晰的模型,例如決策樹(Decision Tree)。此類模型的優點在於決策規則明確、特徵影響程度相對容易說明,較能滿足監理機關對於模型可解釋性的要求。然而,相較於深度神經網路或集成式模型等複雜演算法,這些可解釋性較高的模型在處理高度非線性關係或大量特徵資料時,其預測能力與精準度可能相對受限。因此,金融機構在導入 AI 應用時,通常需要在模型效能與可解釋性之間取得適當平衡,並依據具體應用場景、風險程度及監理要求,選擇合適的模型架構或輔以解釋性技術。畢竟,落實 AI 可解釋性不僅是為了符合合規與治理需求,更是金融業在擁抱 AI 浪潮時,向消費者展現透明度、贏得長期信任的核心競爭力。

作者徐燁儀現為資策會數轉院金科中心研究員,曾任職於保險公司投資部門及金控公司法遵部門。專精於金融法令遵循、合規管理及金融科技產業研究。長期參與台灣金融監理沙盒實驗案,並為金融科技業者提供合規顧問服務。曾參與執行聯徵中心及金融總會等相關智庫研究,並受邀至大專院校演講及擔任國內金融機構數位轉型及 AI 合規工坊講師。國立臺北大學法律學系學士及中信金融管理學院財經法律研究所碩士。

(本文授權非營利轉載,請註明出處:CIO Taiwan)