數位金融詐欺手法多變,傳統仰賴歷史資料的黑箱 AI 詐欺偵測模型,已難以應對,且潛藏資安與合規風險。本文將探討如何運用「可解釋性 AI」(Explainable AI,XAI)技術,結合即時監控,建立透明的詐欺偵測與預防機制。透過 XAI,資安長與資安團隊可解構 AI 模型決策過程,精準識別風險,降低誤報,強化安全事件應變能力。

編譯/Nica

傳統 AI 詐欺偵測系統缺乏透明度,無法有效因應快速演變的手法,更可能成為資安的潛在漏洞。「信用卡詐欺」盜取資訊、取得帳戶變更密碼移轉帳戶餘額的「帳戶接管」、虛擬身份證號碼組合真實地址開設銀行帳戶、製造良好信用記錄再大額透支的「合成詐欺」,及小額頻繁交易躲避檢測的「交易詐欺」,是金融機構的主要威脅。過去對新型態詐欺的遲緩反應,導致資安團隊難以快速精準識別威脅,還引發合規性問題。為此,任職於美國金融控股公司 Capital One 的資深軟體工程師 Swapnil Patil,於 DevOps 技術社群網站 DZone 提出 DeepSeek AI 結合 XAI 的作法,結合即時監控,擺脫傳統詐欺偵測的困境,提升資安防禦的有效性。

本文將介紹 SHAP(SHapley Additive exPlanations)與 LIME(Local Interpretable Model-agnostic Explanations)在詐欺偵測的應用,結合 Streamlit 和 Tableau 監控,協助資安團隊持續最佳化防禦策略。

SHAP 是什麼?

SHAP(SHapley Additive exPlanations) 是一種解釋機器學習模型預測結果的方法。它可以幫助我們理解模型是根據哪些特徵做出某一個預測的,並且每個特徵對預測結果的貢獻是多少。SHAP的核心理論基礎來自「夏普利值」(Shapley value),這是一種源自合作博弈論的分配方法,用來分配各參與者對最終結果的貢獻。套用在機器學習中,就是計算每個特徵在預測過程中的貢獻度。LIME 是什麼?

LIME(Local Interpretable Model-agnostic Explanations) 是一種用來解釋機器學習模型預測結果的技術。LIME 強調「局部解釋」和「模型無關性」,意思是它可以針對單一預測結果做解釋,而且可以應用於任何類型的黑箱模型(不管你原本用的是什麼演算法)。解讀詐欺

可解釋性技術應用範圍極廣,可協助理解醫療機構模型如何預測藥物反應,也可解釋預測結果,檢查資安模型是否對某些特徵過度敏感(如對新 IP 過度警惕)。此外,還能用於詐欺偵測。

在 XAI 領域,有多種工具可協助解釋機器學習模型的行為。例如透過「特徵重要性」(Feature Importance)確定主要影響因素,再利用 SHAP 或 LIME 深入解釋特定案例。解釋機器學習模型的 Feature Importance,特別適合需要全局洞察的情境,還具有最佳化模型功能,刪除無效或弱相關的特徵。Swapnil Patil 使用的 SHAP 和 LIME 是解釋機器學習模型的關鍵技術,可提升模型透明度和信任度,亦為本文探討核心。

▪開源彈性 vs. 商用便利

無論選擇開放源碼客製化,或是 Azure、Google Cloud 與 AWS 等商用平台的整合便利性,都能輕鬆應用 SHAP 與 LIME。就前者而言,LIME 能對基於 TensorFlow/Keras、PyTorch 和 XGBoost 等多種機器學習模型,提供局部解釋;SHAP 則可針對樹模型與深度學習模型,提供特徵重要性分析工具。

商用軟體環境方面,Azure Machine Learning、Google Cloud AI Platform 與 AWS SageMaker 等大型雲端平台,皆整合 LIME 或 SHAP 提供解釋功能。這些平台能協助理解模型的全局與局部決策,並內建合規性工具滿足監管要求。

▪LIME/SHAP 語言與框架工具

選擇支援 SHAP 與 LIME 語言與框架時,需考量產業特性。Python 有開放源碼的彈性,但需加強安全性;商用軟體 MATLAB 穩定且提供合規工具,適用受監管產業;REST API 屬於設計架構,跨平台整合極佳,適合跨部門協作,同樣需確保安全性;自由軟體 R 語言擅長資料分析與視覺化,適用於產生報告。資安長權衡工具時除了合規、技術與成本,還需考量現有系統整合和擴展性,有時混合使用這些工具可能是最佳策略。

▪SHAP 全局解釋 vs LIME 個別交易

在銀行詐欺檢測場景中,SHAP 分析整個資料集中哪些特徵對模型輸出的貢獻最大。例如:交易金額佔主要影響,因為過高金額常與詐欺行為相關。交易地點次要,但特定國家可能風險較高。AWS SageMaker Explain 服務也使用相同的 SHAP 概念提供模型解釋、進行分組、識別詐欺模式,理解不斷演變的詐欺策略。

LIME 擅長詐欺預測的局部解釋。假設檢測信用卡交易是否存在詐欺的機器學習模型,用 LIME 解釋何以判斷某筆交易為「詐欺」。模型輸出為:交易金額大於 4000、交易地點為國外且交易歷史軌跡小於 2。模型判斷這筆交易為詐欺是由於「高額」、「外國」且「帳戶活動少」。這對於處理誤報、理解模型為何將某筆看似正常的交易標記為詐欺,以及證明合規性都有所幫助。

[ 加入 CIO Taiwan 官方 LINE 、 Facebook 與 IG,與全球CIO同步獲取精華見解 ]

SHAP 與 LIME 都屬於模型不可知性(Model-agnostic),這意味著,無論底層使用的機器學習模型是何種演算法(線性迴歸、決策樹、深度學習等),CISO 都能夠使用相同解釋工具理解和驗證模型的決策過程。在高度監管產業,資安長需要確保防禦系統的決策過程能夠被解釋和驗證。模型不可知性讓 CISO 使用標準化解釋工具,清晰呈現模型的決策依據。

可解釋與即時監控完美結合

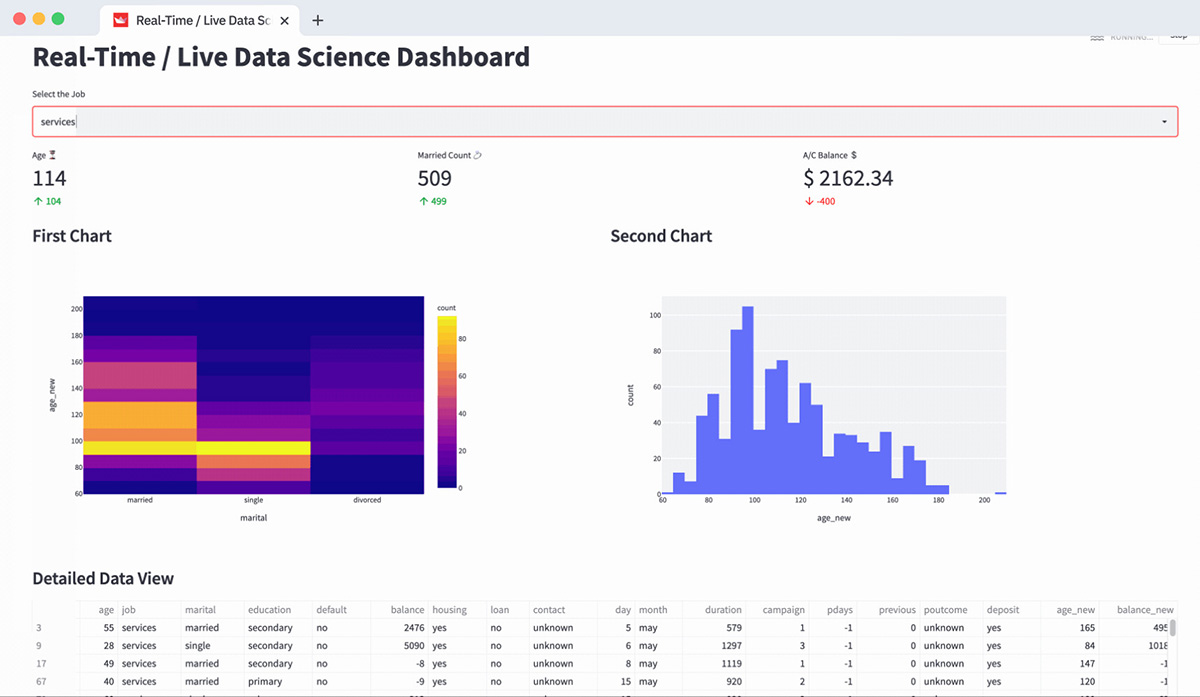

今日,即時詐欺監控已成為資安防禦的關鍵環節。GenAI 搭配 XAI 技術,提升可解釋性,搭配即時監控更能馬上掌握當前詐欺動態,迅速調整防禦策略。透過 Streamlit 和 Tableau 提供的強大視覺化工具,資安團隊能夠當下解讀 AI 模型的決策過程,精準識別潛在威脅,並根據實際情況調整和最佳化防禦系統的效能。這不僅是歷史資料的分析,更是對『正在發生』的威脅快速因應,確保資安防禦體系第一時間應變,提升整體防禦態勢。

▪儀表板掌握現況

快速將資料分析轉換成網頁的 Streamlit 為開放源碼,主要使用 Python 開發。在詐欺檢測場景中,利用 Streamlit 建立的儀表板,可供安全分析師等非技術相關人員輕鬆與 AI 模型的解釋互動。例如在 Streamlit 儀表板上傳銀行交易資料,顯示標記為詐欺的交易,整合 SHAP 的輸出,呈現哪些交易特徵影響詐欺預測。

決策依據透明化、可直觀理解模型判斷關鍵,便容易提供可採取行動的具體見解,由安全分析師驗證模型判斷、調查可疑交易、調整策略。另一套儀表板工具 Tableau 的直觀介面和拖曳式功能,讓非技術背景的業務人員也能輕鬆製作互動式儀表板和報表 。

[ 推薦文章:AI 工具帶動中小企業 AI 轉型 ]

Streamlit 賦予高度的客製化能力,資安人員可根據特定威脅和資安需求,調整儀表板。而這也意味著需要具備技術能力並承擔額外的安全審核責任。相較之下,商業軟體 Tableau 提供專業的資料視覺化報告,能滿足企業級的資安需求。授權成本較高,但內建的合規性工具和技術支援,可能較吸引受監管產業。

▪融合多重技術的未來

企業未來資安防禦,應轉型為主動預警與攔截。生成式 AI 結合可解釋性 AI 與監控的策略,結合「即時資料流處理」,識別大額交易來自高風險地區且時間異常(如深夜),可當下生成警報暫停交易,又或者利用「圖神經網路」分析交易間的關係,發現多筆交易共享可疑 IP 位址,有望定位詐欺組織。針對新型行為模式進行動態調整的「自適應學習」,可由最新詐欺模式自動學習,輔以「強化學習」調整模型,增強預測能力。從被動防禦轉向主動預測,可為企業建立動態適應的資安堡壘。

(本文授權非營利轉載,請註明出處:CIO Taiwan)