歐盟今年有發布的《人工智慧在醫療領域部署研究最終報告》指出 AI 的價值。然而,全球醫療系統的實際部署仍滯後於技術成熟度,背後牽涉的不僅是技術,還有法規、組織與文化等多元因素。作為負責醫療資訊與策略規劃的 CIO,更需要質疑假設、測試邏輯,追求真實而非盲目跟風。

文/黃冠凱(中山醫學大學附設醫院醫療資訊中心副主任)

歐盟研究與最新動態

歐盟今年發佈報告利用調查方法結合文獻回顧、利益關係人諮詢、案例研究與市場分析,對 AI 在醫療的落地有全面型觀察。在歐盟研究指出,AI 能透過流程優化預測病人流量、支援行政紀錄、輔助影像診斷與個人化治療等「低懸果實」,改善資源浪費與人力不足的問題。然而,模型在跨機構部署時經常因資料標準不一與互通性欠缺而表現不佳,缺乏持續監測機制與可解釋性亦抑制臨床信任。

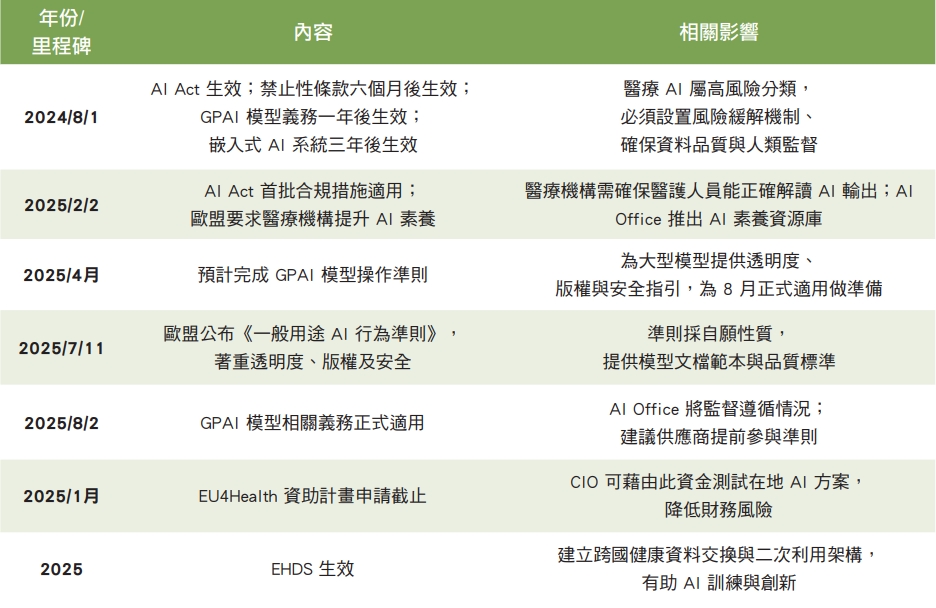

另外值得我們後續注意的是,自從 2024 年 8 月 1 日歐盟《AI 法案》(AI Act)正式生效,規定高風險 AI 系統(包括醫療 AI)必須落實風險緩解、資料品質管控、清楚的使用者資訊與人類監督。法案完整適用的時間表相當細膩:禁止性條款在生效六個月後執行,一般用途 AI 模型(General Purpose AI Model,GPAI)的義務於一年後落實,而嵌入到醫療器材等受監管產品的 AI 系統則需三年後方全數遵行。2025 年 2 月 2 日起,AI Act 第一批合規措施已開始適用,歐盟要求醫療機構加強員工對 AI 的理解能力;歐盟 AI 辦公室還推出「AI 素養學習資源庫」,鼓勵提供最佳實踐與培訓計畫。

而 2025 年的另一大里程碑是歐洲健康資料空間(European Health Data Space,EHDS)生效,它提供跨國資料存取與二次利用的法制架構,可以作為 AI 訓練與創新鋪路,同時強調隱私與安全。同年 7 月 11 日歐盟委員會又發布《一般用途 AI 行為準則》,聚焦透明度、版權與安全三大主題,為大型模型提供自願遵循的作業框架。準則強調模型提供者需完成文件化、公開聯絡資訊與確保資訊品質,並備有「模型文件範本」供業界參考。8 月 2 日後,GPAI 相關義務正式適用,未事先簽署準則的供應商可能面臨更嚴格的監督。

[ 加入 CIO Taiwan 官方 LINE 、 Facebook 與 IG,與全球CIO同步獲取精華見解 ]

此外,歐盟透過 EU4Health 計畫提供資金支持,加速臨床 AI 的部署,2025 年 1 月為申請截止日期。對資源有限的醫療機構而言,這是測試在地 AI 解決方案的重要管道。以上政策動態與研究發現構成了歐洲醫療 AI 生態系的最新地貌。

歐盟時間線:法規與計畫

近期有關醫療 AI 的主要里程碑及其影響。

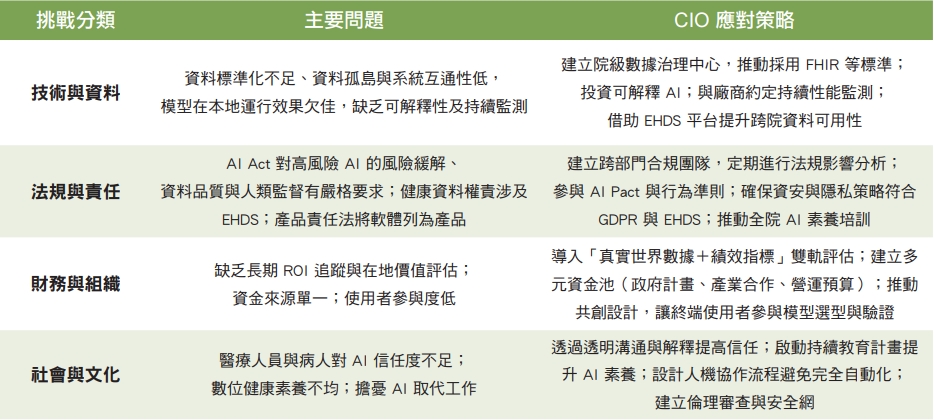

四大挑戰與對策分析

歐盟研究將醫療 AI 部署的障礙分為四大類:技術與資料、法律與監管、組織與財務、社會與文化。每一類挑戰背後都有不同的成因,需要對症下藥。下方表格概括主要問題與 CIO 可採取的策略。

透過這樣的分類可看出,AI 部署並非單純技術議題,而是整體系統性轉型。因此 CIO 不但需要整合內部 IT、臨床、法務與財務團隊,還必須與政策制定者、供應商與病人社群建立完整對話通道。

CIO 的策略啟示

- 以數據治理為核心

多數醫院的 AI 專案失敗,往往是因為資料品質與互通性問題而非模型本身。建立「數據治理中心」作為 AI 專案的根基,包括蒐集、清洗、標準化與共享機制,以保障模型訓練與推論的可靠性。採用通用交換標準(如 FHIR)並確保資料標籤完整,是長遠投資,不應被視為短期成本。另外,EHDS 允許的跨國資料協作值得積極參與,但必須落實 GDPR 與 EHDS 的隱私規範。 - 法規先行與責任框架

AI Act 的合規要求延伸到完整產品生命週期;醫療機構必須確定採購的 AI 系統是否屬於高風險分類,並要求廠商提供風險管理文件與人類監督機制。伴隨 EHDS 與新產品責任法,AI 產生的錯誤可能導致製造商與部署者共同承擔責任。CIO 應主導法規影響分析(Regulatory Impact Assessment),與法務部門共同制定清楚的責任分工與保險策略。

值得留意的是,AI Act 自 2025 年起納入 AI 素養要求。這代表除了技術人員,臨床醫師、護理師與行政人員都必須理解 AI 模型的運作原則,能解讀輸出並適當回饋。CIO 不僅要導入技術,更需規劃教育訓練與考核機制,以符合法規要求。 - 建構可持續的財務與價值評估

報告顯示,許多醫院的 AI 專案缺乏長期 ROI 評估與實際效益追蹤。CIO 可採用「真實世界數據+績效指標」的雙軌驗證:一方面利用 EHDS 的資料基礎與院內數據紀錄來監測模型效果,另一方面建立 KPI 儀表板,例如診斷準確率、報告用時、病人等待時間等,讓管理層與投資人看見具體數據。此外,可利用 EU4Health 等計畫作為試點資金,透過階段性部署降低財務風險。 - 人本設計與數位素養

AI 落地往往因使用者不信任或流程阻塞而失敗,從專案初期引入「共創設計」,讓醫師與護理人員參與需求定義、模型測試與介面設計,可以提高接受度與可用性。對病人而言,需要清楚說明 AI 如何運作與其權益;在 AI 產出介面上提供解釋性資訊與引用來源,也是建立信任的重要一環。此外,應考慮 AI 對工作流程的影響,設計人機協作模式,避免造成過度自動化而讓人員感到被取代。 - 行動指南:從策略到執行

在整合以上洞察後,以下建議可作為 CIO 規劃醫療 AI 的行動藍圖:成立 AI 卓越中心(Center of Excellence):建立跨領域團隊,整合 IT、臨床、法務、財務與倫理專家,形成內部顧問群,負責 AI 專案的選型、驗證、部署與監測。 - 制定 AI 方案目錄與迭代機制:

整理已驗證的 AI 工具庫,包括模型文件、效能指標、使用情境與合規狀態,並與外部醫療機構共享成功案例,加快部署速度。 - 融入醫療數位韌性框架:

將 AI 專案納入資安、業務持續與臨床流程可恢復性的評估,確保在發生故障或法規變化時仍能維持核心服務。 - 主動參與政策與產業社群:

加入 AI Office 的 AI Pact、自願簽署行為準則,與政策制定者保持對話;參與國際合作(如 WHO、OECD 工作小組),吸收最新規範與最佳實踐,並為本地化部署爭取彈性。 - 建立長期教育與監測機制:

將 AI 素養納入員工成長計畫,結合持續的性能監測與模型更新機制,防範模型漂移與偏差。

結語:在真實與創新的交叉路口

醫療 AI 的發展猶如一面鏡子,反映出我們對科技、倫理與社會價值的抉擇。歐盟最新的政策與研究提醒我們,治理框架正迅速形成,醫療機構必須做好準備。作為 CIO,不可被技術光環所迷惑,也不應因合規負擔而裹足不前。只有透過嚴謹的數據治理、全面的法規遵循、人本設計與持續教育,才能在創新的浪潮中守住患者安全與社會信任。

[ 閱讀更多 黃冠凱 的專欄文章 ]

人工智慧終將成為醫療的重要夥伴,但前提是我們願意不斷質疑假設、補足短板並追求真正的價值。這正是 CIO 在數位轉型中最重要的使命,也是醫療 AI 能否帶來真正變革的關鍵。

(本文授權非營利轉載,請註明出處:CIO Taiwan)